Fine-Tuning: ¿Cómo transformar un LLM generalista en un especialista técnico?

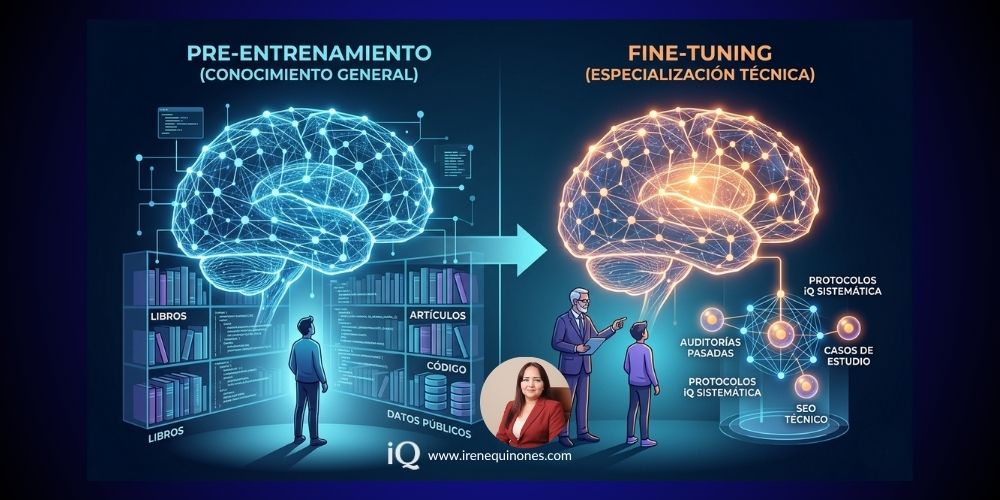

En el ecosistema de la Inteligencia Artificial, la diferencia entre un modelo generalista y una herramienta de alta precisión para ingeniería o consultoría no reside en la potencia bruta, sino en su proceso de especialización. Mientras el pre-entrenamiento construye el “intelecto” global, el Fine-Tuning y el RLHF definen la “competencia” profesional.

En los artículos anteriores, escribí sobre qué son los LLMs y cómo su arquitectura de Transformers les permite “prestar atención” al contexto. Pero, ¿cómo pasa un modelo de saber “un poco de todo” a ser un experto en auditoría SEO, leyes o medicina? La respuesta está en el proceso de especialización.

El Pre-entrenamiento (la creación del modelo fundacional)

Esta es la fase de computación masiva donde nace el “Modelo Fundacional” (como GPT-4 o Llama 3). En esta etapa, el sistema se somete a un aprendizaje autosupervisado sobre petabytes de datos (Common Crawl, GitHub, libros, artículos y foros).

- Objetivo técnico: El modelo no intenta “aprender verdades”, sino predecir el siguiente token. En este proceso, desarrolla capacidades emergentes: gramática, razonamiento lógico básico, programación y una base de conocimiento universal.

- El Resultado: Un “modelo fundacional” con una cultura enciclopédica, pero sin alineación porque no tiene instrucciones sobre cómo comportarse. Como señala AWS Knowledge Center:

“El pre-entrenamiento expone al modelo a una escala de datos que ningún humano podría leer en miles de vidas, creando una base de conocimiento universal.” — AWS Knowledge Center.

Fine-Tuning (o ajuste fino): El postgrado de la IA

Este es el proceso de tomar ese modelo fundacional y reentrenarlo con un dataset curado, específico y de alta calidad para una tarea.

Imagine que el pre-entrenamiento es la carrera de medicina general y el fine-tuning es la especialización en cardiología.

- ¿Por qué hacerlo o cuándo es necesario? Cuando el modelo generalista puede ser demasiado “conversador” o usar un tono inadecuado. El fine-tuning le enseña a responder en un formato específico (por ejemplo, JSON o esquemas de bases de datos), a usar terminología técnica propia de una empresa o a adoptar una voz de marca única.

- Eficiencia sistémica: A diferencia del pre-entrenamiento, el Fine-Tuning requiere menos datos (desde unos pocos cientos hasta miles de ejemplos bien estructurados) y menor potencia de cómputo, pero una calidad de datos superior. Con ello, el modelo puede cambiar drásticamente su comportamiento. Es la especialización en cardiología para un graduado en medicina general.

Alineación mediante RLHF (Reinforcement Learning from Human Feedback)

Incluso después del ajuste fino, el modelo puede ser impredecible. Aquí entra el RLHF (Aprendizaje por Refuerzo con Retroalimentación Humana).

Como señalan los expertos de 3Blue1Brown y OpenAI, se presentan varias respuestas al modelo ante una misma pregunta y evaluadores humanos las clasifican, enseñándole a ser útil, veraz y seguro. Este proceso evita que genere contenido tóxico y asegura que el modelo se comporte como un colaborador profesional y no solo como un predictor estadístico.

Ejemplo: Especialización en Consultoría SEO

Si quisiera crear un asistente de IA para mi propia metodología SEO, el proceso seguiría este flujo:

- Base: Usaría un modelo pre-entrenado (conocimiento general de marketing en buscadores).

- Fine-Tuning: Lo entrenaría con mis propios registros de auditorías pasadas, artículos de blog, estructuras de arquitectura web y estándares de calidad de datos.

- Resultado: Un modelo que “piensa”, redacta y analiza siguiendo los protocolos exactos dados, eliminando la redundancia y ambigüedad que podemos encontrar en una respuesta genérica de ChatGPT.

Conclusión: ¿Cuál elegir?

En el diseño de sistemas inteligentes, el pre-entrenamiento es un bien común, pero el Fine-Tuning es un activo estratégico. La verdadera ventaja competitiva de un ingeniero o consultor no reside en utilizar el modelo más grande del mercado, sino en la capacidad de “domesticar” esa potencia mediante la especialización.

Desde mi visión sistémica, el ajuste fino no es simplemente un entrenamiento adicional; es la reducción deliberada de la entropía informativa. Al alimentar un modelo fundacional con nuestros propios protocolos y estructuras de datos (como en mi caso para SEO), estamos transformando una probabilidad estadística en una herramienta de precisión técnica.

Si en tu empresa consideran que no es necesario entrenar un modelo IA desde cero sino adoptar un modelo fundacional potente y aplicar Fine-Tuning para crear una ventaja competitiva propietaria, toma en cuenta que decidir entre decidir entre un modelo generalista y uno especializado define la calidad del output: mientras el primero ofrece respuestas, el segundo ofrece soluciones alineadas a procesos de negocio. En la ingeniería de sistemas moderna, el éxito no pertenece a quien acumula más datos, sino a quien sabe estructurar la lógica que los gobierna. La IA propietaria es, en última instancia, el reflejo del rigor intelectual de quien la entrena.

0 Comentarios