RAG (Retrieval-Augmented Generation)¿Cómo dar memoria y veracidad en tiempo real a tu LLM?

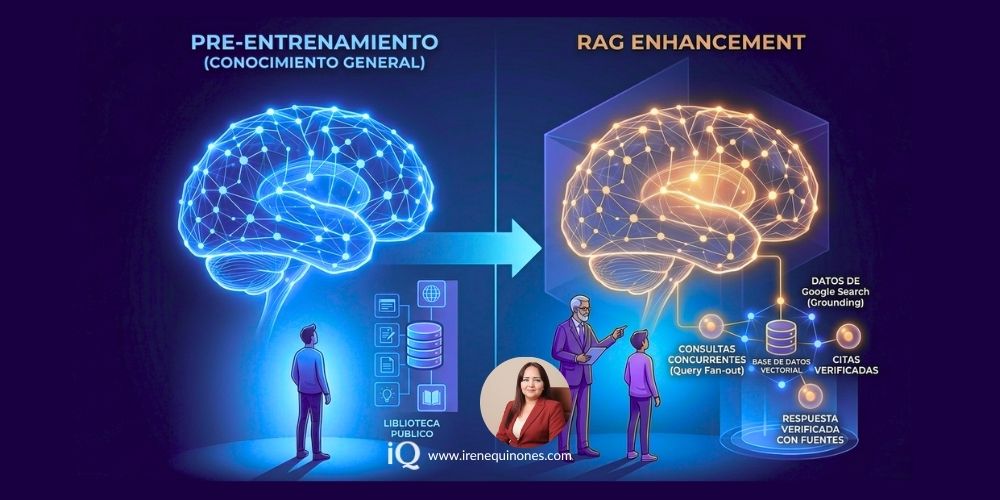

En el artículo anterior, te expliqué cómo el Fine-Tuning especializa a un modelo IA. Sin embargo, incluso un modelo especializado tiene un problema: su conocimiento está “congelado” en el tiempo (el día que terminó su entrenamiento). Si necesitas que la IA responda sobre las ventas de ayer o sobre un cambio legal de última hora, necesitas RAG (‘Retrieval-Augmented Generation ‘, Generación Aumentada por Recuperación).

¿Qué es RAG? La IA con “Libro Abierto”

La Generación Aumentada por Recuperación (RAG) es la técnica que permite a un LLM consultar fuentes de datos externas, dinámicas y confiables antes de generar una respuesta. Mientras que el Fine-Tuning “memoriza”, el RAG “investiga”. Google define este proceso también como grounding (anclaje), un mecanismo esencial para mejorar la precisión y la frescura de las respuestas al basarse en sistemas centrales de clasificación de búsqueda para recuperar páginas web actualizadas.

Imagina que el LLM es un estudiante en un examen.

- Sin RAG: El estudiante (modelo IA) responde basándose solo en lo que memorizó hace meses. Es decir, en lo que aprendió durante su entrenamiento (conocimiento estático)

- Con RAG: El estudiante tiene permiso de consultar un manual actualizado antes de escribir su respuesta, por lo que el sistema localiza información actualizada en una base de datos propia y la entrega al modelo como contexto para su respuesta.

Arquitectura técnica: Del “Chunking” a la respuesta (dato)

Para que un sistema RAG sea eficiente bajo estándares de calidad, sigue tres procesos clave:

- Recuperación (Retrieval): Mediante el uso de Bases de Datos Vectoriales (como Pinecone o ChromaDB), el sistema identifica fragmentos de texto relevantes para la consulta del usuario.

- Aumentación (Augmentation): El sistema combina la pregunta del usuario con la información encontrada, creando un “super-prompt” con contexto real que reduce drásticamente las alucinaciones.

- Generación (Generation): El LLM procesa el contexto y redacta una respuesta coherente, citando fuentes reales.

“RAG reduce drásticamente las alucinaciones al anclar las respuestas del modelo en hechos verificables, lo que lo hace indispensable para aplicaciones empresariales de misión crítica.” — Databricks.

RAG vs. Fine-Tuning: ¿Cuándo usar cada uno?

En la consultoría de procesos IT + SEO, elegir la herramienta correcta es vital para la optimización de recursos:

| Criterio | Fine-Tuning | RAG |

| Objetivo | Cambiar el CÓMO (estilo, tono, formato técnico, vocabulario especializado) | Actualizar el QUÉ (datos dinámicos, documentos externos, noticias o hechos) |

| Frecuencia | Estático / costosos de actualizar | Dinámico /Actualización en segundos |

| Veracidad | Puede alucinar datos viejos | Cita fuentes verificables. |

En la práctica, los sistemas más potentes utilizan ambos: un modelo ajustado para entender el lenguaje de la industria que consulta una base de datos RAG para obtener hechos precisos.

Por ejemplo: Un modelo con Fine-Tuning para entender tu industria, que usa RAG para consultar tus manuales actualizados.

Ejemplo: Soporte Técnico Inteligente

Imagina una empresa de software que lanza actualizaciones cada semana.

- Problema: Entrenar un modelo cada semana es costoso y lento.

- Solución RAG: La empresa sube sus nuevos manuales en PDF a una base de datos vectorial. Cuando un cliente pregunta por una función nueva, el LLM “recupera” el PDF de esa misma mañana y responde: “Según el manual actualizado hoy, la función X se activa así…”.

RAG en la estrategia SEO: La visión de Google

Recientemente, Google ha confirmado que el SEO sigue siendo el pilar fundamental para la IA generativa. Según su documentación oficial, el sistema utiliza técnicas de Query Fan-out (despliegue de consultas) para generar búsquedas relacionadas y concurrentes que alimentan al modelo.

Esto significa que optimizar para RAG es, en esencia, optimizar la experiencia de búsqueda moderna. Cuando un sistema de IA recupera tu contenido para “anclar” su respuesta, no solo utiliza tu información, sino que proporciona enlaces destacados y cliqueables, dirigiendo tráfico de alta calidad hacia tu sitio. Como indica la guía oficial de Google sobre SEO e IA generativa, el contenido único y no genérico es el que mayor probabilidad tiene de ser seleccionado por estos sistemas de recuperación.

Conclusión: Veracidad sobre Creatividad

El RAG ha transformado a los LLMs de “juguetes creativos” a herramientas de consulta empresarial fiables. Es el puente que conecta la potencia lingüística de la IA con la verdad de tus datos, permitiendo que tu marca sea la respuesta oficial en un ecosistema de búsqueda generativa.

0 Comentarios